前言

本文的文字及图片来源于网络,仅供学习、交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理。

作者:黄伟/数据分析与统计学之美

PS:如有需要Python学习资料的小伙伴可以加点击下方链接自行获取

6月12日凌晨0点,周杰伦最新单曲《Mojito》正式上线,仅上线1小时销售量就超过百万张。歌名翻译成中文是莫吉托,一种巴西鸡尾酒,怪不得观看这首歌MV的时候,感受到一股很浓烈的异域风情呢。

周董的上一首单曲《说好不哭》是在2019年9月发布的,这首歌是与老搭档方文山搭档的歌曲,当时这首歌在QQ音乐上的销量超过了1500万张,创造历史新高。而新歌《Mojito》则是与另外一位搭档黄俊郎合作的单曲,相信这首歌肯定也会有不错的销量。

好了回归到正题,既然这首歌大家反应这么大,那么大家都是怎么评论这首歌曲的呢?我们爬取了B站上MV的弹幕数据,看看粉丝们都说了什么。

1.B站弹幕的爬取

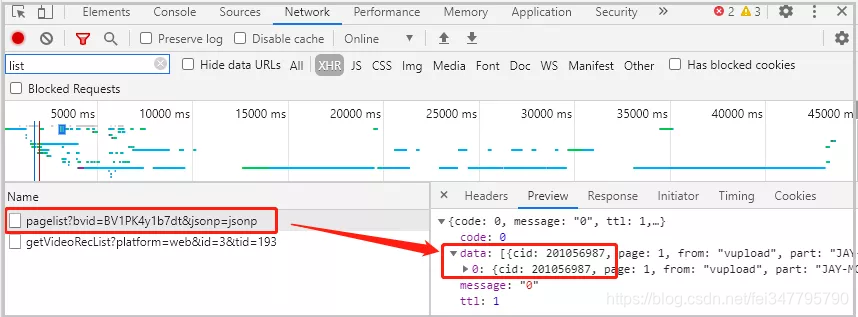

通过Chrome的开发者工具里的Network页面,可以找到B站弹幕数据的接口。如果你自己没找到也没关系,网上能也可找到相关的介绍。

爬取B站弹幕数据的API:

https://api.bilibili.com/x/v1/dm/list.so?oid=XXX

从上述网址中我们看到了一个叫做oid的东西,后面是一串数字,不同的网页有着不同的数字串,因此我这里用“XXX”代替了。我们现在就要思考的是,这个oid我们应该怎么获取呢?不要着急下面带大家一步步查找。

我们要想知道这个oid是什么,首先要获取到cid。弹幕数据的接口我们虽然找不到,但是目录页接口还是可以找到的,网址如下。通过这个网址我们可以获取到我们要的那个cid,cid这个键对应的值,就是我们要的oid数字串。

https://api.bilibili.com/x/player/pagelist?bvid=BV1PK4y1b7dt&jsonp=jsonp

注意:由于这个MV只有一个完整的视频,所以这里只有一个cid,如果一个视频是分不同小节发布的,这里就会有多个cid,不同的cid代表不同的视频。

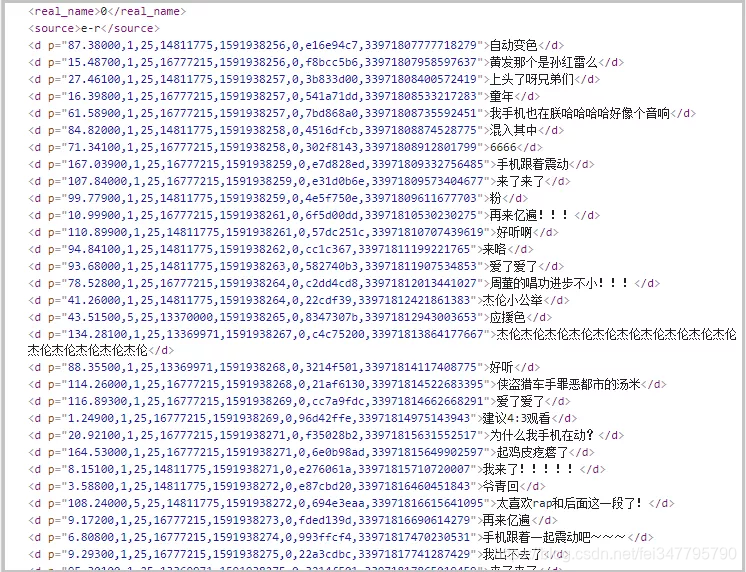

我们将上面接口的url地址和拿到的oid数字串进行拼接,就可以得到这首MV弹幕的真正地址啦,现在把地址提供给大家。我们只需要请求这个网址,解析网页后就可以获取我们想要的数据啦。

https://api.bilibili.com/x/v1/dm/list.so?oid=201056987

这里还有最后一点需要提醒大家的。观察目录页的那个接口(网址如下),里面有一串字符串BV1PK4y1b7dt,我们先不管这个参数是什么,我们只关心这个字符串从哪里来的呢?

https://api.bilibili.com/x/player/pagelist?bvid=BV1PK4y1b7dt&jsonp=jsonp

最后我们观察这首MV的原始网址(网址如下),原来这个字符串就在这首MV的原始网址中。好了,说到这里,我就将B站弹幕数据爬取的一些参数的来龙去脉,给大家讲清楚了,下面我们开始代码部分吧。

https://www.bilibili.com/video/BV1PK4y1b7dt?t=1

代码如下:

import requests

import json

import chardet

import re

from pprint import pprint

# 1.根据bvid请求得到cid

def get_cid():

url = 'https://api.bilibili.com/x/player/pagelist?bvid=BV1PK4y1b7dt&jsonp=jsonp'

res = requests.get(url).text

json_dict = json.loads(res)

#pprint(json_dict)

return json_dict["data"][0]["cid"]

# 2.根据cid请求弹幕,解析弹幕得到最终的数据

"""

注意:哔哩哔哩的网页现在已经换了,那个list.so接口已经找不到,但是我们现在记住这个接口就行了。

"""

def get_data(cid):

final_url = "https://api.bilibili.com/x/v1/dm/list.so?oid=" + str(cid)

final_res = requests.get(final_url)

final_res.encoding = chardet.detect(final_res.content)['encoding']

final_res = final_res.text

pattern = re.compile('<d.*?>(.*?)</d>')

data = pattern.findall(final_res)

#pprint(final_res)

return data

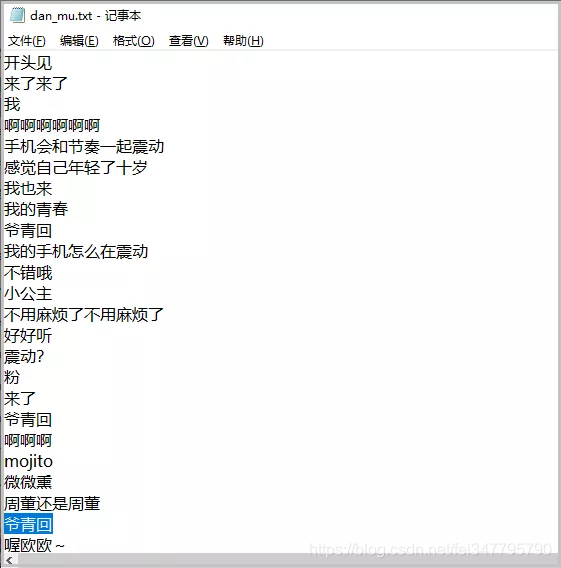

# 3.保存弹幕列表

def save_to_file(data):

with open("dan_mu.txt", mode="w", encoding="utf-8") as f:

for i in data:

f.write(i)

f.write("\n")

cid = get_cid()

data = get_data(cid)

save_to_file(data)

结果如下:

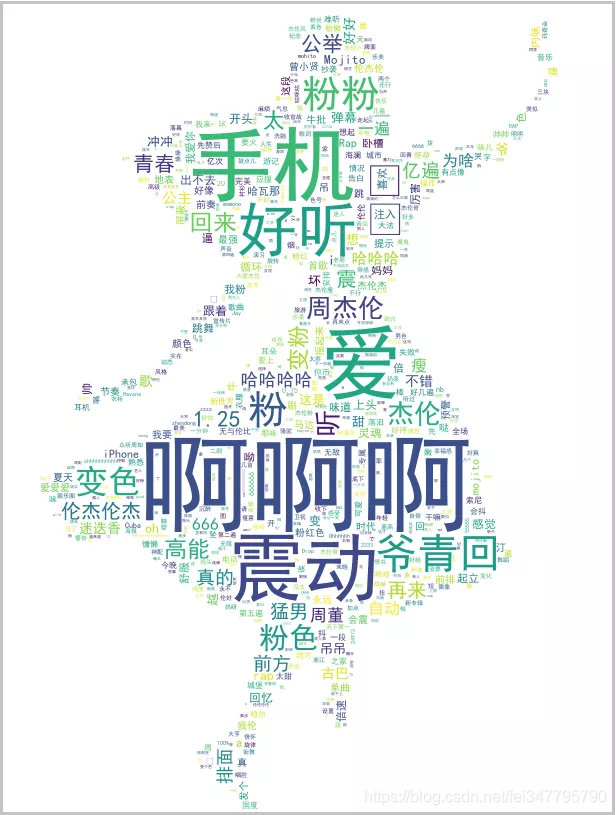

词云图的制作

生成词云的几种方式对比

代码如下:

# 1 导入相关库

import pandas as pd

import jieba

from wordcloud import WordCloud

import matplotlib.pyplot as plt

from imageio import imread

import warnings

warnings.filterwarnings("ignore")

# 2 读取文本文件,并使用lcut()方法进行分词

with open("dan_mu.txt",encoding="utf-8") as f:

txt = f.read()

txt = txt.split()

data_cut = [jieba.lcut(x) for x in txt]

data_cut

# 3 读取停用词

with open(r"G:\6Tipdm\wordcloud\data\stoplist.txt",encoding="utf-8") as f:

stop = f.read()

stop = stop.split()

stop = [" ","道","说道","说"] + stop

# 4 去掉停用词之后的最终词

s_data_cut = pd.Series(data_cut)

all_words_after = s_data_cut.apply(lambda x:[i for i in x if i not in stop])

# 5 词频统计

all_words = []

for i in all_words_after:

all_words.extend(i)

word_count = pd.Series(all_words).value_counts()

# 6 词云图的绘制

# 1)读取背景图片

back_picture = imread(r"G:\6Tipdm\wordcloud\jay1.jpg")

# 2)设置词云参数

wc = WordCloud(font_path="G:\\6Tipdm\\wordcloud\\simhei.ttf",

background_color="white",

max_words=2000,

mask=back_picture,

max_font_size=200,

random_state=42

)

wc2 = wc.fit_words(word_count)

# 3)绘制词云图

plt.figure(figsize=(16,8))

plt.imshow(wc2)

plt.axis("off")

plt.show()

wc.to_file("ciyun.png")

结果如下: