一、数据采集与网络爬虫技术简介

网络爬虫是用于数据采集的一门技术,可以帮助我们自动地进行信息的获取与筛选。从技术手段来说,网络爬虫有多种实现方案,如PHP、Java、Python ...。那么用python 也会有很多不同的技术方案(Urllib、requests、scrapy、selenium...),每种技术各有各的特点,只需掌握一种技术,其它便迎刃而解。同理,某一种技术解决不了的难题,用其它技术或方依然无法解决。网络爬虫的难点并不在于网络爬虫本身,而在于网页的分析与爬虫的反爬攻克问题。希望在本次课程中大家可以领会爬虫中相对比较精髓的内容。

二、网络爬虫技术基础

在本编中,将使用Urllib技术手段进行项目的编写。同样,掌握了该技术手段,其他的技术手段也不难掌握,因为爬虫的难点不在于技术手段本身。本知识点包括如下内容:

- Urllib基础

- 浏览器伪装

- 用户代理池

- 糗事百科爬虫实战

需要提前具备的基础知识:正则表达式

1)Urllib基础

爬网页

打开python命令行界面,两种方法:ulropen()爬到内存,urlretrieve()爬到硬盘文件。

>>> import urllib.request

#open百度,读取并爬到内存中,解码(ignore可忽略解码中的细微错误), 并赋值给data

>>> data=urllib.request.ulropen("http://www.baidu.com").read().decode("utf-8”, “ignore")

#判断网页内的数据是否存在,通过查看data长度

>>> len(data)

提取网页标题

#首先导入正则表达式, .*?代表任意信息,()代表要提取括号内的内容

>>> import re

#正则表达式

>>> pat="<title>(.*?)</title>"

#re.compile()指编译正则表达式

#re.S是模式修正符,网页信息往往包含多行内容,re.S可以消除多行影响

>>> rst=re.compile(pat,re.S).findall(data)

>>> print(rst)

#[‘百度一下,你就知道’]同理,只需换掉网址可爬取另一个网页内容

>>> data=urllib.request.ulropen("http://www.jd.com").read().decode("utf-8", "ignore")

>>> rst=re.compile(pat,re.S).findall(data)

>>> print(rst)上面是将爬到的内容存在内存中,其实也可以存在硬盘文件中,使用urlretrieve()方法

>>> urllib.request.urlretrieve("http://www.jd.com",filename="D:/我的教学/Python/阿里云系列直播/第2次直播代码/test.html")之后可以打开test.html,京东网页就出来了。由于存在隐藏数据,有些数据信息和图片无法显示,可以使用抓包分析进行获取。

2)浏览器伪装

尝试用上面的方法去爬取糗事百科网站url="https://www.qiushibaike.com/",会返回拒绝访问的回复,但使用浏览器却可以正常打开。那么问题肯定是出在爬虫程序上,其原因在于爬虫发送的请求头所导致。

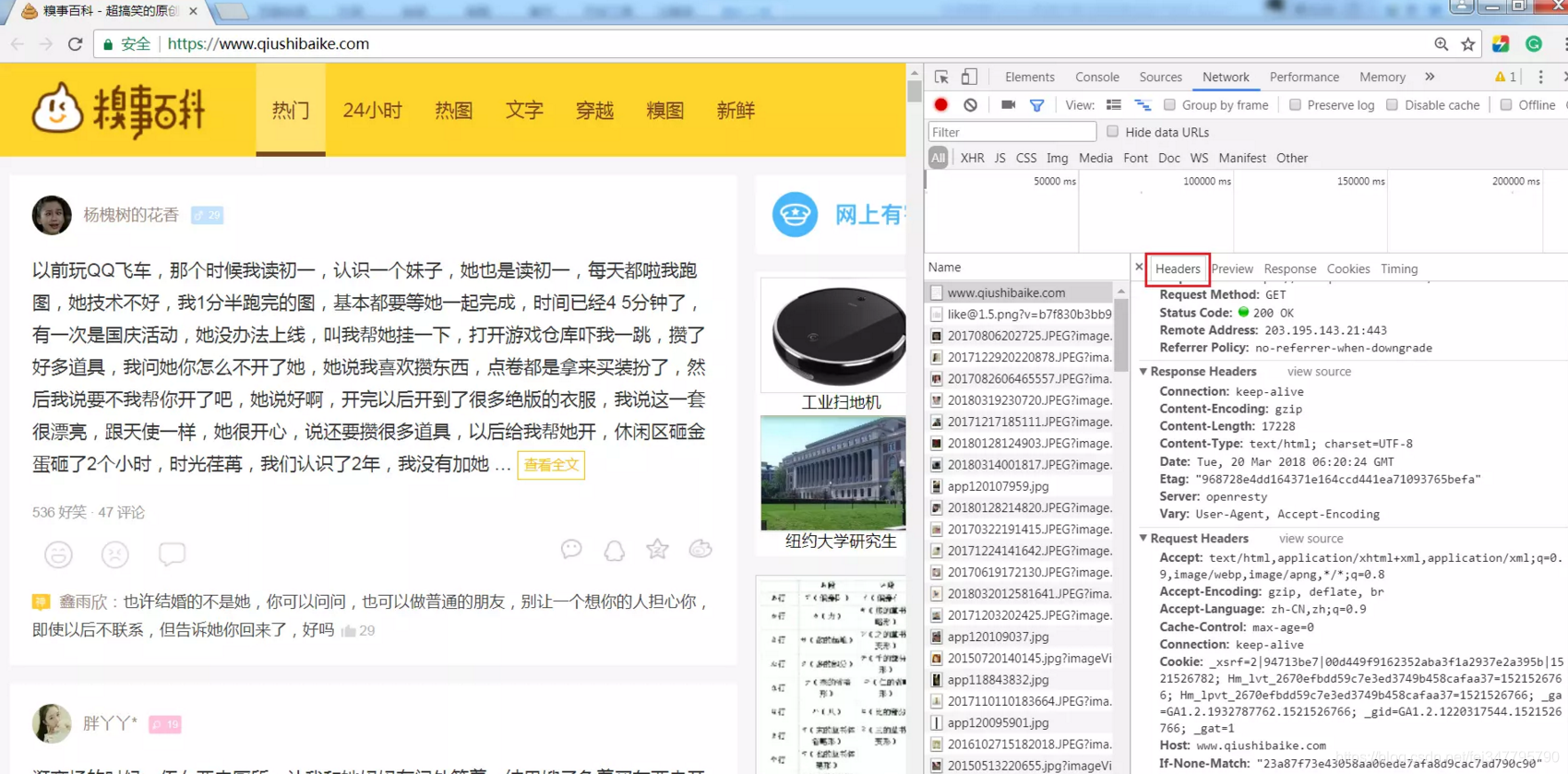

打开糗事百科页面,如下图,通过F12,找到headers,这里主要关注用户代理User-Agent字段。User-Agent代表是用什么工具访问糗事百科网站的。不同浏览器的User-Agent值是不同的。那么就可以在爬虫程序中,将其伪装成浏览器。

将User-Agent设置为浏览器中的值,虽然urlopen()不支持请求头的添加,但是可以利用opener进行addheaders,opener是支持高级功能的管理对象。代码如下:

#浏览器伪装

url="https://www.qiushibaike.com/"

#构建opener

opener=urllib.request.build_opener()

#User-Agent设置成浏览器的值

UA=("User-Agent","Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/49.0.2623.221 Safari/537.36 SE 2.X MetaSr 1.0")

#将UA添加到headers中

opener.addheaders=[UA]

urllib.request.install_opener(opener)

data=urllib.request.urlopen(url).read().decode("utf-8","ignore")3)用户代理池

在爬取过程中,一直用同样一个地址爬取是不可取的。如果每一次访问都是不同的用户,对方就很难进行反爬,那么用户代理池就是一种很好的反爬攻克的手段。

第一步,收集大量的用户代理User-Agent

#用户代理池

uapools=[

"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/51.0.2704.79 Safari/537.36 Edge/14.14393",

"Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/49.0.2623.22 Safari/537.36 SE 2.X MetaSr 1.0",

"Mozilla/4.0 (compatible; MSIE 7.0; Windows NT 5.1; Maxthon 2.0)",

]第二步,建立函数UA(),用于切换用户代理User-Agent

def UA():

opener=urllib.request.build_opener()

#从用户代理池中随机选择一个

thisua=random.choice(uapools)

ua=("User-Agent",thisua)

opener.addheaders=[ua]

urllib.request.install_opener(opener)

print("当前使用UA:"+str(thisua))for循环,每访问一次切换一次UA

for i in range(0,10):

UA()

data=urllib.request.urlopen(url).read().decode("utf-8","ignore")每爬3次换一次UA

for i in range(0,10):

if(i%3==0):

UA()

data=urllib.request.urlopen(url).read().decode("utf-8","ignore")(*每几次做某件事情,利用求余运算)

糗事百科爬虫实战

目标网站:https://www.qiushibaike.com/

需要把糗事百科中的热门段子爬取下来,包括翻页之后内容,该如何获取?

第一步,对网址进行分析,如下图所示,发现翻页之后变化的部分只是page后面的页面数字。

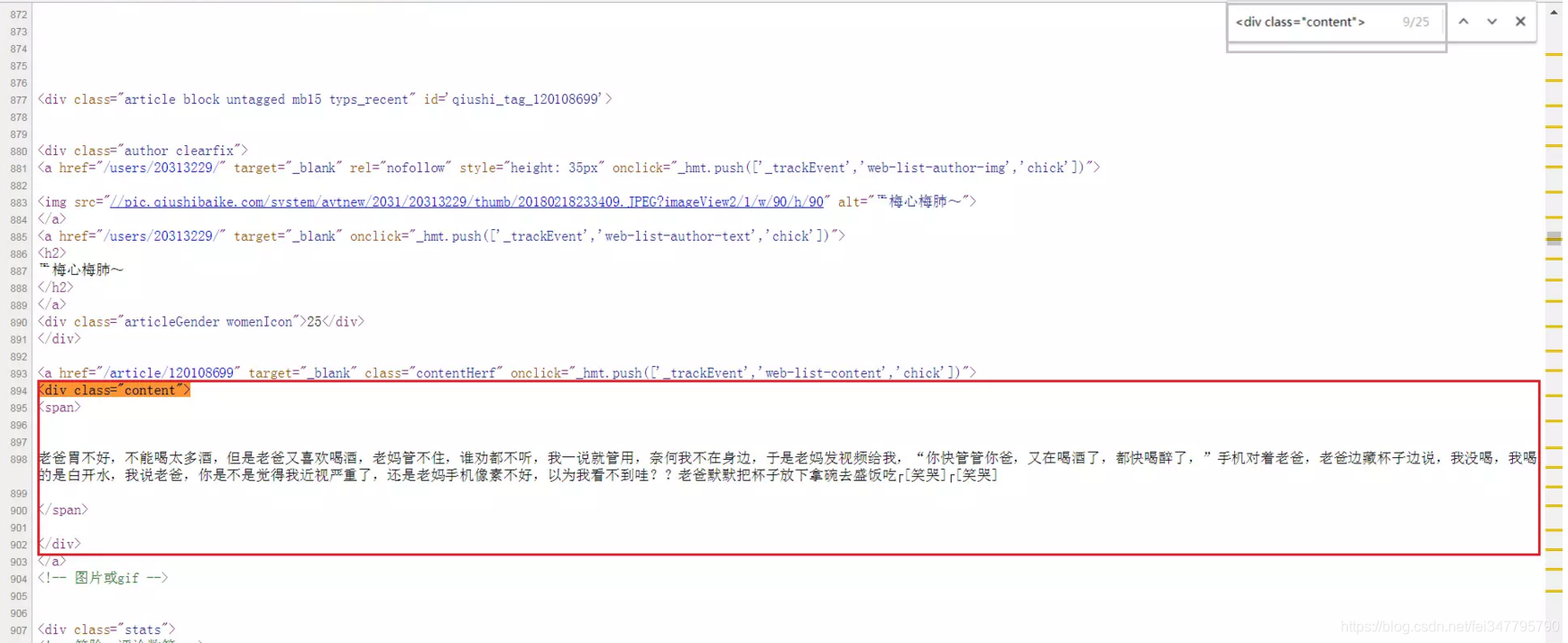

第二步,思考如何提取某个段子?查看网页代码,如下图所示,可以发现<div class="content">的数量和每页段子数量相同,可以用<div class="content">这个标识提取出每条段子信息。

第三步,利用上面所提到的用户代理池进行爬取。首先建立用户代理池,从用户代理池中随机选择一项,设置UA。

import urllib.request

import re

import random

#想要学习Python?Python学习交流群:984632579满足你的需求,资料都已经上传群文件,可以自行下载!

#用户代理池

uapools=[

"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/51.0.2704.79 Safari/537.36 Edge/14.14393",

"Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/49.0.2623.22 Safari/537.36 SE 2.X MetaSr 1.0",

"Mozilla/4.0 (compatible; MSIE 7.0; Windows NT 5.1; Maxthon 2.0)",

]

def UA():

opener=urllib.request.build_opener()

thisua=random.choice(uapools)

ua=("User-Agent",thisua)

opener.addheaders=[ua]

urllib.request.install_opener(opener)

print("当前使用UA:"+str(thisua))

#for循环,爬取第1页到第36页的段子内容

for i in range(0,35):

UA()

#构造不同页码对应网址

thisurl="http://www.qiushibaike.com/8hr/page/"+str(i+1)+"/"

data=urllib.request.urlopen(thisurl).read().decode("utf-8","ignore")

#利用<div class="content">提取段子内容

pat='<div class="content">.*?<span>(.*?)</span>.*?</div>'

rst=re.compile(pat,re.S).findall(data)

for j in range(0,len(rst)):

print(rst[j])

print("-------")还可以定时的爬取:

Import time

#然后在后面调用time.sleep()方法换言之,学习爬虫需要灵活变通的思想,针对不同的情况,不同的约束而灵活运用。